関連記事

東芝と理研、コンパクトDNNでAIを高速化 エッジでの推論は加速するか

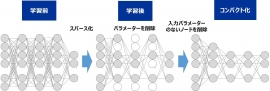

深層ニューラルネットワークのコンパクト化イメージ(写真:東芝の発表資料より)[写真拡大]

東芝と理化学研究所(理研)は17日、人工知能(AI)の「深層ニューラルネットワーク(DNN: Deep Neural Networks)」のコンパクト化技術を開発したと発表した。

【こちらも】東芝メモリ、演算エネルギー効率を4倍改善するAIプロセッサ開発 FPGAで確認

AIは着実に身の周りの製品に組み込まれている。エアコンやスマホはAIでより快適になっている一方で、自動運転、ロボット、医療、IoTなど新たな分野でのAI活用は旺盛だ。このAIの分野で最も実用化が進んでいるのが深層学習(ディープラーニング)であり、AIの学習や推論の記録を塗り替えている。深層学習は、大別してAI開発時の学習プロセスとAI適用時の推論プロセスから成る。その両プロセスの課題は高速化だ。学習プロセスの高速化は、開発期間短縮に繋がり、推論プロセスの高速化は、瞬時に物事を判断するアルタイム性の確保に繋がる。

今回発表のDNNは、深層学習における人間の脳を模したニューラルネットワークである。学習や推論プロセスの高速化には、複数のGPU(Graphics Processing Unit)の並列処理化によるハードウェアの高速化とDNNの最適化による高速化の道がある。

前者の最新事例ではソニーやNVIDIAがある。ソニーは11月13日、分散学習において各GPUの負荷分散を均一にすることと各GPU間のオーバーヘッドを最小化することで、従来の半分という世界最高の学習速度を達成したことを発表。一方、NVIDIAは12月13日、推論を司るエッジデバイスとして、32TOPS(Tera Operations Per Second)の性能を誇るプラットフォームを発表。

後者の最新事例では、東芝が11月6日、ディープラーニングの積和演算をニューラルネットワークの各層ごとの定数を最適化し、演算エネルギー効率が約4倍に改善したと発表。今回の発表は、DNNの性能を維持したままで学習した結果であるパラメーターを80%削減する内容だ。

技術の詳細は、12月17日から20日に開催の国際会議、IEEE International Conference on Machine Learning and Applications (ICMLA) 2018で発表する。

●DNNのコンパクト化の特長

高い性能を実現するDNNは、大規模で複雑化する。このDNNを用いて高性能の推論を実施しリアルタイム性を満たそうとすると、エッジデバイスに搭載された演算性能やメモリ容量が制約となる。DNNの性能を維持したままで学習した結果であるパラメーターを80%削減し、エッジデバイス上での推論を可能にする。

●ニューラルネットワーク(東芝、DNNのコンパクト化)のテクノロジー

深層学習を行う際に、DNNの一部のパラメーターが自動的にゼロ近傍に収束する「スパース化現象」があるという。ゼロとなったパラメーターは認識結果に影響しないため削減が可能だ。つまり、深層学習後のDNNの不要なパラメーターを削除することで、演算性能を向上させ、かつメモリ利用量を削減する。

組み込み機器やエッジデバイスにおける高度なDNNの活用にむけて研究開発を進め、2~3年後の実用化を目指す。(記事:小池豊・記事一覧を見る)

スポンサードリンク